Estudiantes desarrollan modelo con redes neuronales artificiales para traducir lengua de señas

Jesús Quiroz y María Camila Gómez, de Ingeniería Electrónica, trabajan en un prototipo que utiliza técnicas avanzadas de inteligencia artificial como machine learning y Deep learning.

En un esfuerzo por abordar las barreras de comunicación que enfrentan las personas con discapacidad auditiva, Jesús David Quiroz Rojas y María Camila Gómez, estudiantes de noveno semestre de Ingeniería Electrónica en la Universidad del Norte, desarrollan un modelo de inteligencia artificial que busca traducir la lengua de señas a texto y voz, y ofrecer una solución innovadora y oportunidad de facilitar estrategias de educación inclusiva.

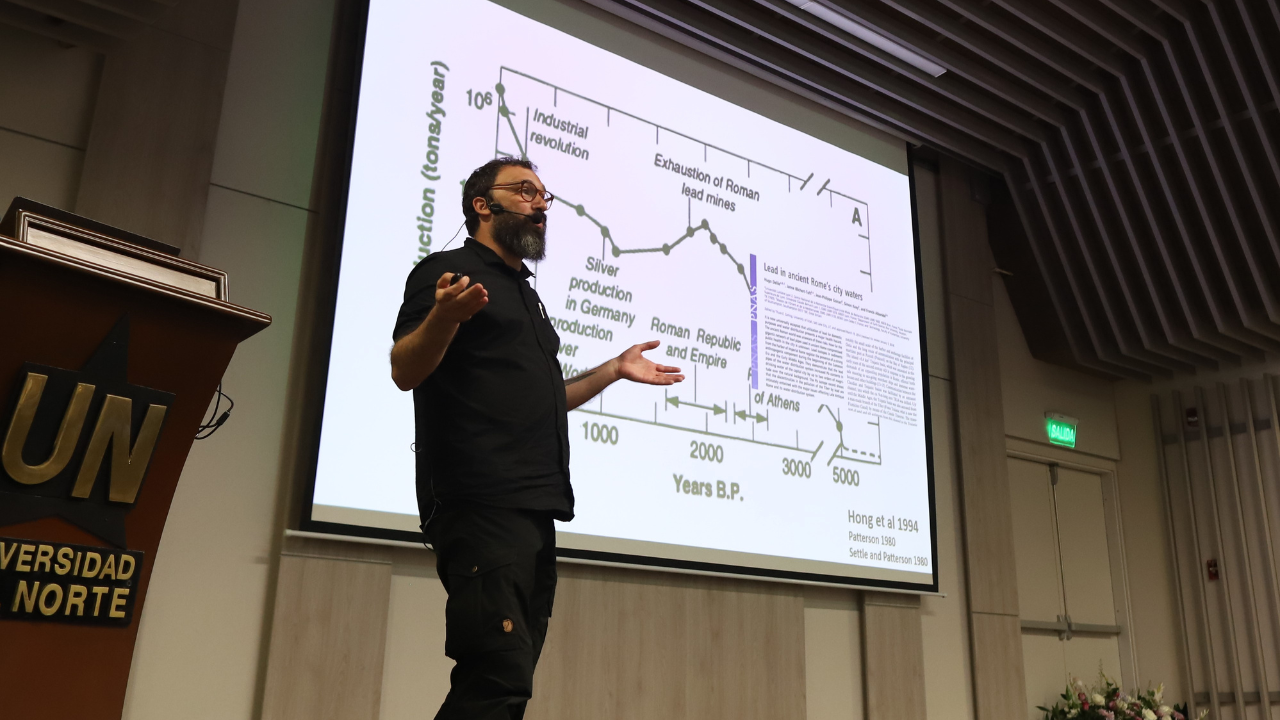

Bajo la guía del profesor Winston Percy Brooks, quien alentó en el segundo semestre de 2023 a los estudiantes a desarrollar un proyecto con impacto social significativo, Jesús y María Camila se embarcaron en la tarea de explorar diversas posibilidades. Finalmente, optaron por centrarse en el desarrollo de un modelo de traducción de lengua de señas, que usa técnicas avanzadas de inteligencia artificial como machine learning y deep learning.

"La mayoría de personas no aprende lengua de señas y siempre es difícil la comunicación con las personas con discapacidad auditiva. Tengo conocidos y vecinos que tienen este tipo de discapacidad", comenta Jesús, bachiller del IED El Pueblo y becario Generación E, al igual que María Camila.

Estas experiencias personales de Jesús, sumado a que desde el colegio le gusta leer textos sobre las funcionalidades del cerebro y la neurociencia, a raíz de la isquemia que sufrió un familiar, sirvieron de catalizador para iniciar este proyecto personal y llevar a ambos jóvenes al camino de la investigación.

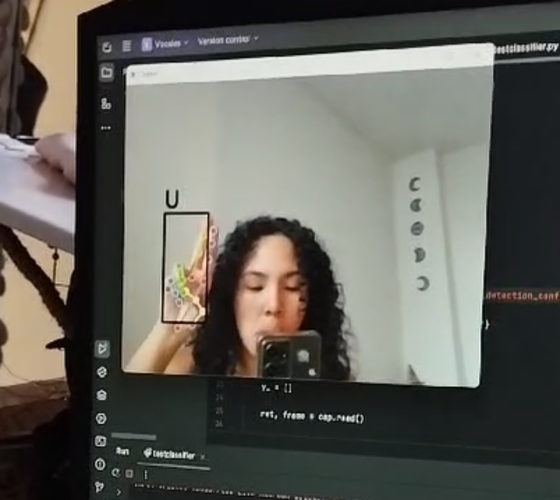

La aplicación en principio usaba un modelo predictivo de árbol de decisión, pero lo cambiaron a un modelo LSTM (Long Short Term Memory). De esta forma, utiliza una combinación de redes neuronales artificiales y técnicas de procesamiento de imágenes para detectar y traducir los gestos de la lengua de señas.

"El modelo detecta la figura de la mano, gracias a una librería de Google, la cual marca unos puntos clave de la mano y hace la unión de esos puntos para obtener una imagen de líneas o de esqueleto de esta. De ahí lo que hacemos es extraer esos puntos y, basados en la posición que tienen esos puntos y su distancia, determinamos cuál es la posición exacta de la mano en ese momento y así el tipo de seña", explica el joven barranquillero.

El prototipo no solo se centra en la detección precisa de gestos, también pretende integrar una funcionalidad de traducción de texto a voz, mediante una API, lo que permitirá una comunicación más fluida y accesible para las personas con discapacidad auditiva.

"Desde hace dos años vengo trabajando con inteligencia artificial. Todo comenzó con una exposición en sexto semestre para una asignatura, sobre crear interfaces y mostrar gráficas. De ahí surgió la idea de programar. He aprendido de forma empírica, tengo varios libros, como Deep Learning for Vision Systems, de Mohamed Elgendy, y he hecho cursos. La mayoría de libros los he prestado de la biblioteca de aquí”, afirma Jesús.

Para su proyecto final de grado, los dos estudiantes desarrollan también un sistema de monitoreo para cuidado de personas de la tercera edad. Mediante una cámara en un sitio específico de la casa, el sistema es capaz de reconocer si el anciano tuvo una caída o muestra de dolor y enviar una alerta al cuidador, mediante una página web y una API de WhatsApp.

“Hoy se ve una dicotomía en la inteligencia artificial, sobre si favorecerá o perjudicará a la sociedad, pero siento que todo depende de cómo la encaminemos. Este proyecto es prueba de eso. Con la IA se puede crear ese tipo de soluciones que ayudan a solventar situaciones que antes era mucho más complejas. Luego de terminar mi proyecto de grado me seguiré enfocando en el proyecto del modelo de señas. Seguir escalándolo para que en su momento contribuya a la comunidad", recalca el estudiante.

El proyecto de Jesús y María Camila destaca la importancia de aprovechar las nuevas tecnologías para abordar desafíos sociales y promover la inclusión. Con una combinación de dedicación, conocimientos técnicos y una visión altruista, estos estudiantes están allanando el camino hacia un futuro más accesible y equitativo para todos.

Más noticias

Abr 26, 2024

Histórico

Abr 26, 2024

Histórico

Abr 26, 2024

Histórico

español

español inglés

inglés francés

francés alemán

alemán